Oleh: Jaya Suprana, Budayawan dan Pendiri MURI

AKIBAT hanya beda huruf awal A dan E serta akhiran K dan tanpa akhiran apapun, semula saya duga antropik sama saja dengan entropi atau antropik adalah typo entropi atau sebaliknya. Ternyata dugaan saya keliru. Antropik sama sekali beda dari entropi.

Meski terus terang saya kerap menyebut entropi sebagai entropik karena entropik dengan akhiran K menurut selera subyektif saya terkesan lebih keren ketimbang entropi tanpa akhiran huruf K.

Entropi adalah besaran fisika yang mengukur tingkat ketidakteraturan, keacakan, atau penyebaran energi dalam suatu sistem. Dalam termodinamika, entropi menunjukkan energi yang tidak dapat digunakan untuk melakukan usaha, dan sistem cenderung bergerak menuju entropi tinggi (lebih tidak teratur) secara spontan. Karena saya sudah pernah menulis naskah tentang entropi, maka kali ini saya lebih fokus pada antropik.

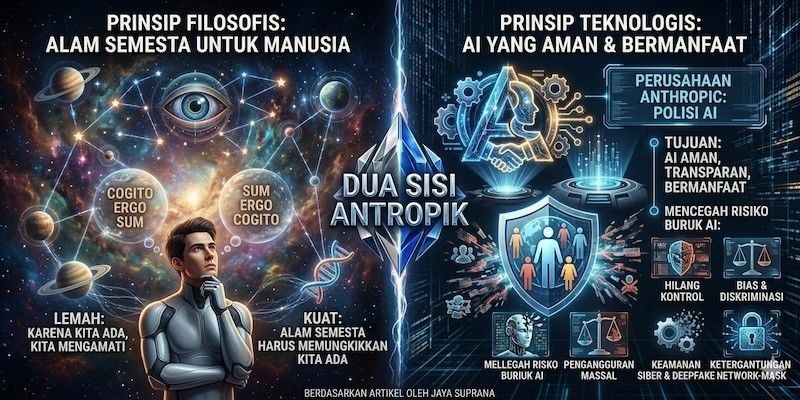

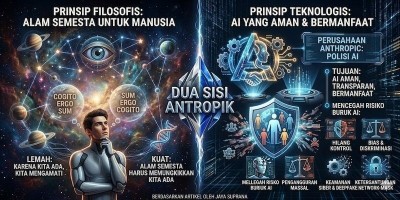

Antropik merujuk pada sesuatu yang berhubungan dengan manusia atau aspek kemanusiaan. Dalam konteks filosofi, anthropic principle (prinsip antropik) adalah konsep yang menyatakan bahwa alam semesta harus sesuai dengan keberadaan manusia sebagai pengamat. Ada juga Anthropic sebagai nama perusahaan AI yang fokus pada pengembangan AI yang aman dan bermanfaat bagi manusia.

Anthropic principle (prinsip antropik) dibagi menjadi dua:

- Prinsip Antropik Lemah: Alam semesta harus sesuai dengan keberadaan kita sebagai pengamat, karena jika tidak, kita tidak akan ada untuk mengamatinya.

- Prinsip Antropik Kuat: Alam semesta harus memiliki sifat-sifat yang memungkinkan kehidupan dan kesadaran manusia muncul.

Secara prinsip, inti makna filsafat antropik bersuasana mirip cogito ergo sum versi Rene Desrates maupun sum ergo cogito versi kaum pemikir aliran eksistensialisme dan mereka yang menyetujuinya, termasuk saya.

Lain filsafat lain nama perusahaan.

Perusahaan Anthropic fokus pada pengembangan AI yang aman, transparan, dan bermanfaat bagi manusia. Mereka ingin memastikan AI digunakan untuk kebaikan dan tidak menimbulkan risiko buruk terutama terhadap manusia.

Dapat dikatakan bahwa perusahaan Anthropic berperan sebagai polisi Kecerdasan Buatan agar tidak menimbulkan risiko buruk terhadap manusia.

Risiko buruk AI termasuk:

- Kehilangan kontrol: AI bisa menjadi sangat canggih sehingga sulit dikontrol atau diprediksi.

- Bias dan diskriminasi: AI bisa memperkuat bias yang ada dalam data pelatihan.

- Pengangguran massal: Automatisasi bisa menggantikan pekerjaan manusia.

- Keamanan: AI bisa digunakan untuk serangan siber atau pembuatan konten palsu (deepfake).

- Ketergantungan: Manusia bisa terlalu bergantung pada AI dan kehilangan kemampuan kritis.

Menurut saya secerdas-cerdasnya Kecerdasan Buatan sebenarnya sekadar alat seperti pisau yang nilai baik-buruk tergantung bagaimana dan untuk tujuan apa manusia menggunakannya. Serupa tapi tak sama dengan Fasisme dan Nazisme.

KOMENTAR ANDA